-

Notifications

You must be signed in to change notification settings - Fork 2

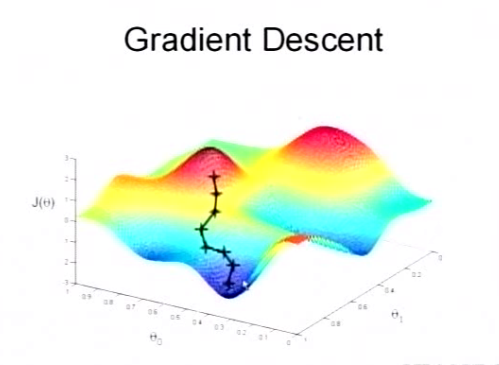

Stochastic Gradient Descent

O Gradiente Descendente é uma técnica numérica para determinar pontos mínimos e máximos de uma função. Em ML o SGD é utilizado para aproximar funções à um determinado dado.

Nas implementações de algoritmos dentro do sklearn o SGD se encontra de várias formas, tanto como otimizador (algoritmo original) quanto modelos lineares e não lineares de aprendizagem.

O SGD Classifier é um implementação do sklearn de um modelo de aprendizagem linear que aproxima os dados a funções lineares.

Esse módulo é utilizado para regularização de dados dando suporte a regularizações com penalidade, como por exemplo l1, l2 e elasticnet.

- l1 e elasticnet: oferece de 'penalidade' à features

- l2: padrão do modelo sklearn, é o regulador padrão para modelos SVMs

Com este módulo podemos regularizar dados aproximando-os a uma função linear de forma prática, porém, em muitos casos essa aproximação não é muito efetiva.

[1] Ensaio sobre SGD criado por satishjasthi - link

[2] Tutorial SGD no sklearn - link

[3] Documentação SGDClassifier - link

[4] Referência imagem 1 - link

[5] Gradient Discente Wikipedia - link